人と人とのインタラクション:オンライン会議時の理解度

情報学専攻 修士課程2年 佐藤矯汰郎

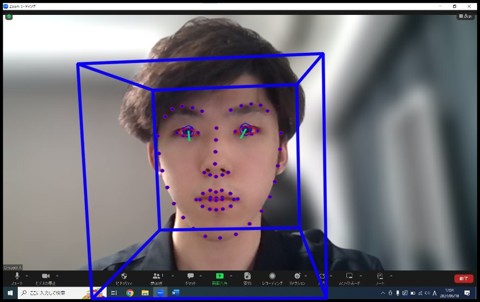

コロナ禍を契機に普及したオンライン会議では、対面に比べ参加者の理解度が低下する課題が指摘されています。本研究は会議の円滑な進行を支援するため、顔画像から理解度を推定することを目的に進められています。オンライン会議実験を実施し、顔の向きの変化や表情の筋肉の動き、さらに時間的な変動を特徴量として分析しました。その結果、理解時には頷きが、不理解時には動きの小ささが確認され、時系列特徴量の追加により推定精度の向上が示されました。これらの成果は研究会でも発表しており、今後は音声や表情を含むマルチモーダル情報を統合し、より高精度なモデル構築を目指します。